AI ফেস অ্যাপ দিয়ে তৈরি করা হল কলকাতার মৃত চিকিৎসকের ভিডিও

এই অনুসন্ধান একটি বিব্রতকর ঘটনা তুলে ধরে যেখানে ভারতের এক যৌন নিপীড়ন ও হত্যার ভুক্তভোগীর ছবি কৃত্রিম বুদ্ধিমত্তা ব্যবহার করে সম্পাদনা করা হয়েছে।

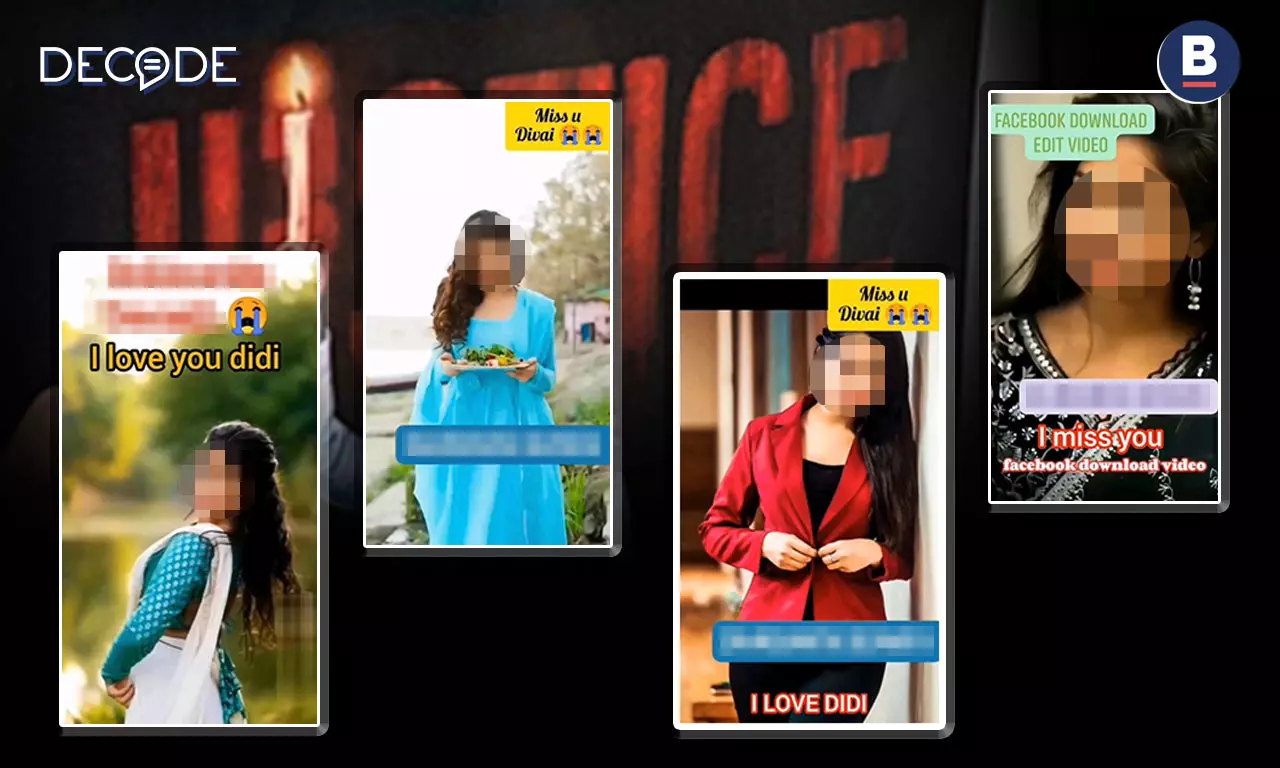

ডিকোড অনুসন্ধান করে দেখে অগাস্টের শুরুতে কলকাতার একটি হাসপাতালে ধর্ষিত ও খুন হওয়া এক চিকিৎসকের ছবি একটি কৃত্রিম বুদ্ধিমত্তার দ্বারা মুখ অদলবদল করার অ্যাপের সাহায্যে সম্পাদনা করে ভাইরাল ইউটিউব শর্টস এবং ফেসবুক রিল তৈরি করা হয়েছে।

কৃত্রিম বুদ্ধিমত্তা দ্বারা ছবি সম্পাদনা করার অ্যাপ, ফটো ল্যাবে ব্যবহারকারীরা তাদের নিজস্ব ছবি আগে থেকে প্রস্তুত টেমপ্লেটগুলির সাথে মুখ অদলবদল করতে পারে। অ্যাপটিতে উপস্থিত ভারতীয় মহিলা মডেলের টেমপ্লেট ক্লিপে নির্যাতিতার মুখ অদলবদল করে বেশ কয়েকটি ভিডিও তৈরি করা হয়েছে । ভিডিওগুলি কে তৈরি করেছে তা স্পষ্ট নয়।

ডিকোডের অনুসন্ধানটি একটি বিব্রতকর পরিস্থিতিকে তুলে ধরেছে যেখানে ভারতের এক যৌন নিপীড়ন ও হত্যার ভুক্তভোগীর ছবি কৃত্রিম বুদ্ধিমত্তা ব্যবহার করে সম্পাদনা করা হয়েছে।

"এটা খুবই সমস্যাজনক। কারণ 'জাস্টিস ফর (নির্যাতিতার নাম)' ঘিরে বৃহত্তর আলোচনার জন্য মৃত চিকিৎসকের ছবি ব্যবহার করা অন্য জিনিস", রতি ফাউন্ডেশনের সহ-প্রতিষ্ঠাতা ও পরিচালক উমা সুব্রমনিয়ান ডিকোডকে বলেছেন।

এই সংস্থা যৌন অত্যাচারে আক্রান্ত শিশু ও মহিলাদের নিয়ে কাজ করে।

“কিন্তু আমরা এমন পর্যায়ে এসেছি যেখানে মানুষে নির্যাতিতার ছবি নিয়ে এমন ভিডিও তৈরি করছে যা ন্যায়বিচার বা কোনও অর্থপূর্ণ আলোচনার সাথে সম্পর্কিত নয়। মানুষ কাজটি করছে কারণ তারা কোনও শাস্তি ছাড়াই এটি করতে পারে। এটি নির্যাতিতার গোপনীয়তা এবং মর্যাদার গুরুতর লঙ্ঘন করে", সুব্রমনিয়ান বলেন।

ডিকোড ইন্ডিয়ান ইনস্টিটিউট অফ টেকনোলজি যোধপুরের সঙ্গে যোগাযোগ করে। তাদের নিজস্ব ডিপফেক শনাক্তকারী ইতিসার নিশ্চিত করে ক্লিপগুলি সম্পাদিত এবং ভুয়ো।

এই কৃত্রিম বুদ্ধিমত্তার সাহায্যে তৈরি ভিডিওগুলি আপলোড করা ব্যবহারকারীদের ভাইরাল করে তোলে।

এমন একটি ফেসবুক রিল ২.২ মিলিয়ন বার চালানো হয়েছে এবং ৫৫,০০০ লাইক পেয়েছে।

পশ্চিমবঙ্গের একটি ইউটিউব চ্যানেল, যা নিয়মিত কৃত্রিম বুদ্ধিমত্তার তৈরি ভিডিও পোস্ট করে কিন্তু খুব কমই ভিউ পায়, নির্যাতিতার ছবি ব্যবহার করে পাঁচটি ফটো ল্যাব ভিডিও আপলোড করেছে।

ভিডিওগুলির মধ্যে একটিতে ৭,৪৫,০০০ ভিউ ছিল এবং অন্যটি এই প্রতিবেদনটি প্রকাশ অবধি ২,০৬,০০০ ভিউ ছিল।

রোহিণী লক্ষণে, একজন স্বাধীন গবেষক এবং প্রযুক্তিবিদ, ডিকোডকে বলেন যে প্রাথমিক প্রেরণা প্রায়শই অর্থের জন্য আসে। "এই ঘটনাটি সংবাদ চক্রের মধ্যে রয়েছে। চ্যানেলের মালিকরা জানেন মানুষ এই ভিডিওগুলি খুঁজছে এবং তারা এই চলতি সংবাদ তরঙ্গের সুযোগ নিতে চায়", বলেন তিনি।

ডিকোড কলকাতার মৃত চিকিৎসকের অন্যান্য ছবিও পেয়েছে যা কৃত্রিম বুদ্ধিমত্তার ফটো এডিটিং অ্যাপ ব্যবহার করে সম্পাদনা করা হয়েছে।

মূল ছবিগুলি নির্যাতিতার ইনস্টাগ্রাম অ্যাকাউন্ট থেকে সমাজমাধ্যম ব্যবহারকারীরা চুরি করেছে। এই প্রতিবেদনটি লেখার সময়ও অনলাইনে ছিল মৃতার অ্যাকাউন্ট। ইনস্টাগ্রাম ব্যবহারকারীরা অনেক পোস্টের কমেন্টে এই হত্যার বিষয়ে ষড়যন্ত্র তত্ত্ব ছড়িয়ে দিয়েছেন।

ফটো ল্যাবঃ ছবি থেকে বাস্তব জীবনেও সম্পাদনা

ডিকোড অন্যান্য ব্যবহারকারীদের একই টেম্পলেট ব্যবহার করতে দেখে নিশ্চিত হয় ভিডিওগুলি ফটো ল্যাবের দ্বারা নির্মিত। তৈরি নিশ্চিত করতে সক্ষম হয়েছিল কারণ আমরা অ্যাপের অন্যান্য ব্যবহারকারীদের দ্বারা ব্যবহৃত শর্ট মোশন ক্লিপগুলির একই টেমপ্লেট খুঁজে পেয়েছি। ভিডিওগুলিতে কালো শাড়ি পরিহিত এক যুবতীক, একটি মেয়ে রাস্তা দিয়ে হেঁটে যাচ্ছে, নীল সালোয়ার পড়া একটি মেয়েকে সিঁড়ি দিয়ে উঠতে, ইত্যাদি দেখানো হয়েছে। ভিডিওগুলি ৪ সেকেন্ডের বেশি নয়, নরম আলো এবং প্রাণবন্ত রঙদিয়ে তৈরি ভিডিও কখনো কখনো অবাস্তব লাগে দেখতে।

সান ফ্রান্সিসকোর লিনারক ইনভেস্টমেন্ট লিমিটেড কৃত্রিম বুদ্ধিমতা এডিটিং ফটো এডিটর অ্যাপটি ভারতীয় ইন্টারনেট ব্যবহারকারীদের মধ্যে জনপ্রিয়, যারা অ্যাপটিতে উপলব্ধ বিভিন্ন ফিল্টার ব্যবহার করে তাদের ছবি আপলোড এবং সম্পাদনা করে। বিভিন্ন বয়সের বেশ কয়েকজন ভারতীয় মহিলা ফটো ল্যাবের সাহায্যে ইনস্টাগ্রামে রিল আপলোড করেছেন। একইভাবে, ইউটিউবে ভারতীয় ভাষায় টিউটোরিয়াল ভিডিওগুলি অন্যদের কীভাবে অ্যাপটি ব্যবহার করতে হয় তা শেখায়।

কৃত্রিম বুদ্ধিমত্তা ও অন্যান্য

কলকাতা চিকিৎসক ধর্ষণ ও হত্যাকে কেন্দ্র করে সম্পাদিত ছবি এবং ভিডিওগুলি একমাত্র ভুয়ো জিনিস নয়।

কৃত্রিম বুদ্ধিমত্তা এবং কৃত্রিম বুদ্ধিমত্তা ছাড়া কিছু ক্লিপ পাকিস্তান এবং বাংলাদেশের সোশ্যাল মিডিয়া ব্যবহারকারীরা তৈরি করছে।

ডিকোড ইউটিউবে মৃত ডাক্তারের জন্য ন্যায়বিচার চেয়ে এআই দিয়ে তৈরি কয়েকটি গানও পেয়েছে।

এরকমই একটি গানে মৃতা চিকিৎসককে দেবী দুর্গার সঙ্গে তুলনা করে একটি ক্ষুব্ধ বাংলা র্যাপ দিয়ে পোস্ট করা হয়েছে একটি বাংলাদেশী ইউটিউব চ্যানেল। ভিডিওটির থাম্বনেলে কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি নির্যাতিতার একটি ছবি দেখা যায়।

"আমি সম্প্রতি কলকাতার খবরটি দেখেছি। বাংলাদেশ থেকে আমি এই ঘটনার দৃষ্টান্তমূলক ন্যায়বিচার চাই। এই গানটি কেবল একটি প্রতিবাদ ", ডিকোডকে বলেন বিহাইন্ড ৫-এর ব্যবস্থাপনা পরিচালক নাজমাস সাকিব।

"গানের থাম্বনেলের জন্য লিওনার্দো এআই এবং গানের জন্য সুনো এআই ব্যবহার করা হয়। এই চ্যানেলের সমস্ত বিষয়বস্তু এআই ব্যবহার করে তৈরি করা হয়েছে এবং আপলোডের সময়ও এআই দ্বারা নির্ধারিত হয়।"

কলকাতার ঘটনায় জেনারেটিভ এআইয়ের সবচেয়ে বেশি ব্যবহার হল কৃত্রিম বুদ্ধিমত্তার তৈরি চিত্রগুলি যা ক্রিয়েটররা ইউটিউব ভিডিওর থাম্বনেল হিসাবে ব্যবহার করছে ।

কৃত্রিম বুদ্ধিমত্তার তৈরি বেশিরভাগ চিত্রায়নে অনেক ক্ষত এবং রক্তের দাগযুক্ত ছেঁড়া সাদা ল্যাব কোট পড়া এক মহিলা ডাক্তারের বিব্রতকর দৃশ্য দেখা যায়।

ছবিগুলি প্রায়শই ভারতে যৌন নিপীড়নের ঘটনা সম্পর্কে রিপোর্ট করার জন্য মূলধারার সংবাদ সংস্থাগুলির দ্বারা ব্যবহৃত ডিজিটাল চিত্র এবং প্রতীকী চিত্রগুলির পুনরুজ্জীবিত এআই সংস্করণের বলে মনে হয়।

ইউটিউবাররা কোনও সময় নষ্ট না করে সম্পূর্ণরূপে কৃত্রিম বুদ্ধিমত্তা নির্মিত চিত্র এবং কৃত্রিম বুদ্ধিমত্তার ভয়েসওভার দিয়ে তৈরি ভিডিও তৈরি করেছে যেখানে ট্রু-ক্রাইম ঘরানায় এই মর্মান্তিক খুনের সম্বন্ধে তথ্য দেওয়া হয়েছে।

সোশ্যাল মিডিয়ার যুগে নির্যাতিতার পরিচয় গোপন অসম্ভব হয়ে পরে

২০২৪ সালের ৯ অগাস্ট আরজি কর মেডিকেল কলেজের ঘটনার পর থেকে ন্যায়বিচারের দাবি অনলাইন এবং অফলাইন উভয় জায়গাতেই ভরে গেছে। তবে, ভারতীয় আইন অনুযায়ী ধর্ষিতার পরিচয় গোপন থাকার কথা থাকলেও সেটি ব্যাপকভাবে প্রকাশিত হয়েছে। ভারতীয় আইন তাদের এবং তাদের পরিবারকে সমাজের কটূক্তি থেকে মুক্ত করার জন্য ভুক্তভোগীর নাম প্রকাশ করেনা।

অপরাধস্থলে পাওয়া ভুক্তভোগীর দেহের ছবি, তার অন্ত্যেষ্টিক্রিয়ার ছবি, তার বাবা-মায়ের সাংবাদিকদের সাথে কথা বলার ভিডিও, তার নাম ব্যবহার করে ন্যায়বিচারের জন্য হ্যাশট্যাগ এবং তার ইনস্টাগ্রাম অ্যাকাউন্ট থেকে চুরি হওয়া ছবিগুলি সোশ্যাল মিডিয়ায় ছড়িয়ে পড়েছে।

কলকাতা হাইকোর্ট এবং ভারতের সুপ্রিম কোর্ট, যারা এই মামলাটি স্বতঃপ্রণোদিতভাবে গ্রহণ করেছিল, তারা হস্তক্ষেপ করে সোশ্যাল মিডিয়া প্ল্যাটফর্মগুলিকে আদেশ দেয় নির্যাতিতার পরিচয় প্রকাশ করা পোস্ট সরিয়ে ফেলতে।

তবুও এক্স, ইউটিউব, ইনস্টাগ্রাম এবং ফেসবুকের মতো সোশ্যাল মিডিয়া প্ল্যাটফর্মগুলি এই ধরনের পোস্ট নিয়ন্ত্রণ করতে এবং সরিয়ে নিতে দেরি করেছে ।

রতি ফাউন্ডেশনের উমা সুব্রমনিয়ান বলেন, "জীবিত ভুক্তভোগী বা পরিবার বা তাদের ঠিকানা প্রকাশ করা আইন দ্বারা সীমাবদ্ধ করার একটি বৃহত্তর কারণ রয়েছে।"

তবে, সুব্রমনিয়ান জীবিত ভুক্তভোগী প্রাপ্তবয়স্ক এবং মৃত হলে তাদের পরিবার সম্পর্কে একটি সূক্ষ্ম আলোচনার প্রয়োজনীয়তার উপর জোর দেন।

ন্যায়বিচারের দাবি এখন ভয়েউরিজমের দিকে

ডিকোড আগেও জানায় কীভাবে অপরাধের পরের সপ্তাহে ভুক্তভোগীর নামের পরে কীওয়ার্ড 'পর্ন' বা 'ধর্ষণ ভিডিও' ব্যবহার করে অনলাইনে অনুসন্ধান বেড়ে গেছিল।

সোশ্যাল মিডিয়া ইনফ্লুয়েন্সার এবং রূপটান শিল্পীরাও মৃত চিকিৎসক সেজে রিল তৈরি করেন যেখানে তারা অপরাধের একটি কাল্পনিক চিত্রনাট্য 'পুনরায়' তৈরি করেন।

বেশ কয়েকজন এক্স ব্যবহারকারী একটি ইনস্টাগ্রাম অ্যাকাউন্ট নির্যাতিতার ছবি চুরি করে সেগুলি সম্পাদনা করেছে বলে অভিযোগ করেন। চিকিৎসকের নামে তৈরি করা ভুয়ো অ্যাকাউন্টের বিবরণে 'ধর্ষণের শিকার' ব্যবহার করা হয়েছে। ইনস্টাগ্রাম অ্যাকাউন্টটি বন্ধ করে দেয়।

গবেষক রোহিণী লক্ষণে বলেন, ইলন-মাস্কের প্ল্যাটফর্মে মৃত ব্যক্তিদের বিষয়ে নীতি থাকা সত্ত্বেও তিনি এক্স-এ অপরাধস্থলে কলকাতার ডাক্তারের মৃত দেহের অস্বস্তিকর ছবি শেয়ার করা বেশ কয়েকটি পোস্ট দেখতে পেয়েছেন।

লক্ষণে বলেন, সামাজিক বৃত্তের মধ্যে সম্পৃক্ততা, বিশ্বাসযোগ্যতা এবং বৈধতার চাহিদা এই ধরনের বিষয়বস্তু পোস্ট করার অন্যান্য কারণ হতে পারে যখন অর্থ প্রধান উদ্দেশ্য নয়।

"এটি তাদের ভিউ এবং অনুসরণকারী এবং একটি নির্দিষ্ট ধরনের সামাজিক বৈধতা এবং গুরুত্ব এনে দেবে, যা অন্য একটি বিষয় আমি গোপনীয়তা লঙ্ঘনকারী বিশয়বস্তুর সাথে দেখেছি যা সম্মতি ছাড়াই প্রচারিত হয়েছে। এর মধ্যে সম্মতিহীন ছবি, ধর্ষণের ভিডিও ইত্যাদি অন্তর্ভুক্ত রয়েছে। যেখানে প্রতিশোধ বা অর্থের মতো অন্য কোনও প্রেরণা নেই বলে মনে হয় এমন লোকেরাও এটি শেয়ার করে নিচ্ছেন কারণ এটি তাদের সেই সম্প্রদায়ের মধ্যে খ্যাতি অর্জন করে ", লক্ষণে বলেন।

লক্ষণে আরও বলেন, "যদিও আপনার এবং আমার বিষয়টি ঘৃণ্য মনে হতে পারে, একটি নির্দিষ্ট "ভ্রাতৃত্ব" রয়েছে যেখানে এগুলি তাদের সামাজিক বৈধতা এবং বিশ্বাসযোগ্যতা দেবে।"

লিঙ্গভিত্তিক অনলাইন অপব্যবহারের অন্যতম অস্ত্র কৃত্রিম বুদ্ধিমত্তা

যৌন নির্যাতনের ভুক্তভোগীর ছবি সম্পাদনা করতে কৃত্রিম বুদ্ধিমত্তার ব্যবহার একটি নৈতিক বিষয়।

নগ্ন অ্যাপ বা যে কোনও ব্যক্তির ছবি 'স্ট্রিপ' করতে সক্ষম এমন অ্যাপের ব্যবহারের উত্থান দেখায় জেনারেটিভ এআই কীভাবে লিঙ্গভিত্তিক অনলাইন অপব্যবহারের অন্যতম অস্ত্র এবং এর শিকার মূলতঃ মহিলারা হয়।

সংশ্লেষিত অসম্মতিসূচক চিত্র তৈরি করতে জেনারেটিভ এআইয়ের অপব্যবহার হতে পারে এমন আশঙ্কা ভিত্তিহীন নয়, বিশেষত এমন ক্ষেত্রে যেখানে যৌন নিপীড়নের হাত থেকে বেঁচে যাওয়া ব্যক্তিরা একইরকম সহানুভূতি নাও পেতে পারে।

"অবশ্যই এটি ভুক্তভোগীর জন্য দুঃখজনক এবং বিধ্বংসী হতে পারে, এবং যদি ভুক্তভোগী মারা যান, তবে তাদের নিকটবর্তীদের জন্য। একবার জিনটি বোতল থেকে বেরিয়ে গেলে, একবার ভিডিওটি ইন্টারনেটে ভাইরাল হয়ে গেলে, পীড়িত ব্যক্তির পক্ষে ইন্টারনেটের সর্বত্র থেকে স্থায়ীভাবে এটি সরিয়ে ফেলা প্রায় অসম্ভব", লক্ষণে বলেন।

"সুতরাং এখন আপনাকে কেবল মূল বিষয়বস্তুর সাথে মোকাবিলা করতে হবে না, আপনাকে ক্লিকবেটগুলির সাথেও মোকাবিলা করতে হবে, যেখানে এটি অন্য কেউ বা আপনাকে এআই ব্যবহার করে ভুয়ো চিত্রের সাথে মোকাবিলা করতে হবে ইত্যাদি। সুতরাং ভুক্তভোগীর জন্য এটি অবশ্যই নতুন করে দুঃখজনক হতে চলেছে। এই ভুক্তভোগীদের মধ্যে অনেকেই আত্মহত্যার কথা ভাবেন ", তিনি আরও বলেন।

রতি ফাউন্ডেশনের উমা সুব্রমনিয়ান বলেন, যৌন নির্যাতনের ক্ষেত্রে আরও সক্রিয় ব্যবস্থা এবং শূন্য সহনশীলতার দৃষ্টিভঙ্গি প্রয়োজন।

"আমি মনে করি কলকাতার ধর্ষণ হল সবচেয়ে খারাপ ধরনের নির্যাতন এবং এটি আবার ঘটেছে। কিন্তু অনলাইনে অপব্যবহারের একাধিক উদাহরণ রয়েছে যা প্রতিদিন নতুন করে সামনে আসে, এআই দ্বারা হোক অথবা অন্য ভাবে", সুব্রমনিয়ান বলেন।

" এক বছর আগে রাস্তায় নেমে কুস্তিগীরদের প্রতিবাদ একটি উদাহরণ। মহিলা কুস্তিগীররাও নিরাপত্তার দাবি করছিল, তাই না? কিন্তু আমরা আজ যে ধরনের পরিবর্তন চাই, তার জন্য সত্যিই চাপ দিইনি, তাই না?"

"বৃহত্তর প্রশ্ন হল, এই ধরনের বীভৎস ঘটনা ঘটলেই কি আমরা একটি দেশ হিসেবে এই বিষয়ে মনোযোগ দেব? অথবা মহিলারা বাস্তব বা অনলাইনে নিরাপদ বোধ করায় আমরা কি সক্রিয় পদক্ষেপ নিতে যাচ্ছি?"

তিনি বলেন, "আমরা নির্যাতিতাদের কথা নিয়মিত ভাবে শুনি না। প্রকৃত পরিবর্তন তখনই আসবে যখন আমরা তা করার জন্য প্রতিজ্ঞাবদ্ধ্ব হব।"

ডিকোড মন্তব্যের জন্য ইউটিউব এবং লিনারক ইনভেস্টমেন্ট লিমিটেডের সঙ্গে যোগাযোগ করেছে। উত্তর পেলে প্রতিবেদনটি আপডেট করা হবে।

অতিরিক্ত রিপোর্টিংয়ে নিবেদিতা নিরঞ্জনকুমার